Tagged#本地部署

3 posts found

oMLX

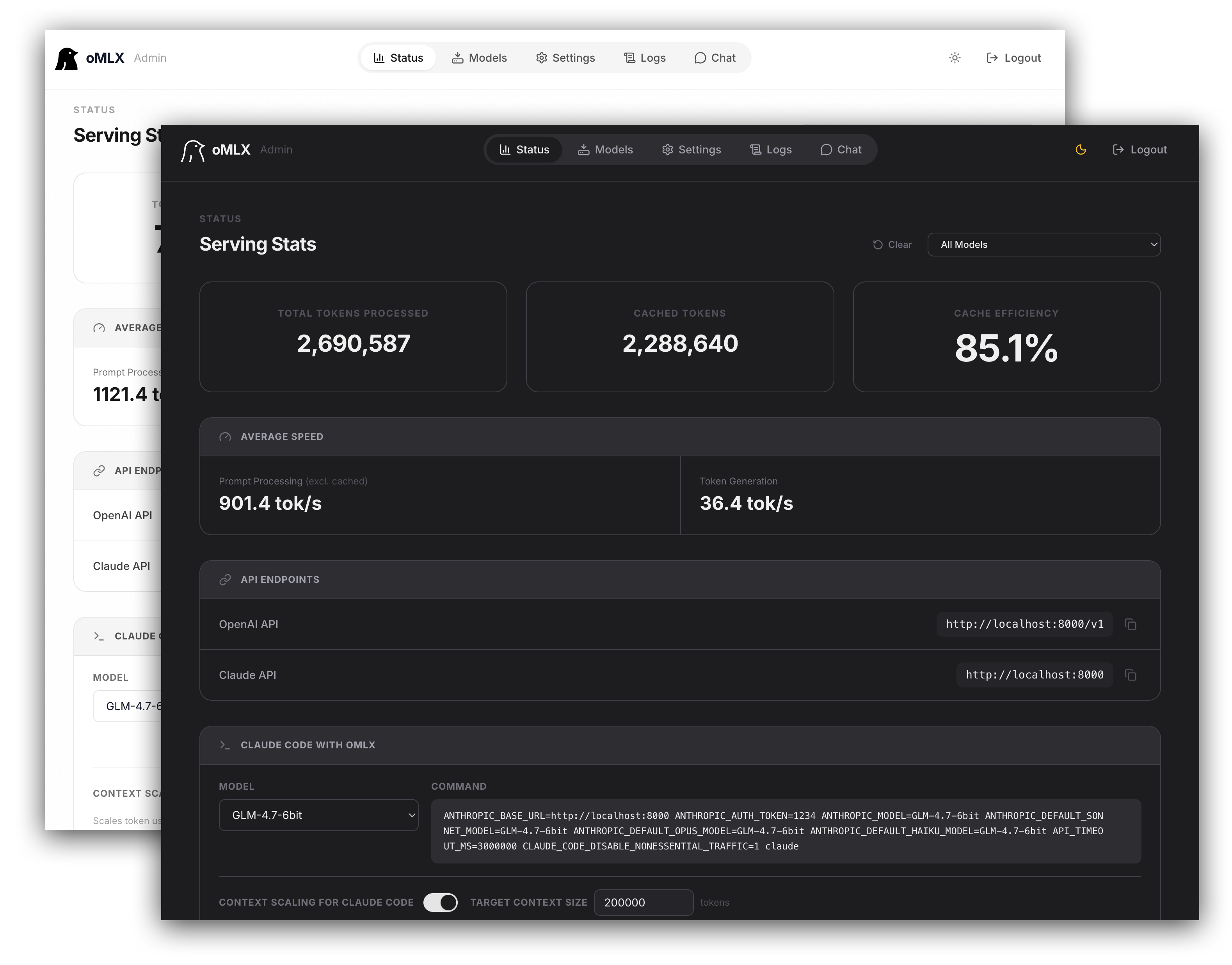

oMLX:苹果M系列Mac上本地跑大模型的神器——10倍提速、多并发爽玩

oMLX 是专为 Apple Silicon 设计的本地 LLM 推理服务器,通过连续批处理和分层 KV Cache(热 RAM + 冷 SSD)实现 10 倍提速,丐版 Mac Mini 也能多并发跑大模型。

NanoClaw

NanoClaw vs OpenClaw:2026 最值得关注的本地个人AI助手对比

NanoClaw 和 OpenClaw 深度对比——两大开源个人 AI 代理的架构、安全性、功能与适用场景全面解析,帮你选出最适合的本地 AI 助手。

AnythingLLM

AnythingLLM 完全指南:开源全能 RAG + AI Agent 平台

深入了解 AnythingLLM——一款集 RAG、AI Agents、多模型支持于一体的开源全栈 AI 应用。完全本地优先、隐私友好、开箱即用。